本ドキュメントでは Cisco HyperFlex HX220c 120GB SSD の交換手順についてご説明いたします。

[交換対象パーツ]

UCS-SD120GBKS4-EV

[事前に必要な情報]

・UCSM のIP アドレス、ユーザー名、パスワード

・交換対象ノードのController VM の IP アドレス、root パスワード

・交換対象ノード以外のController VM(任意の1台) の IP アドレス、root パスワード

・HX Data Platform installer VM のIPアドレス、 root パスワード

[作業前確認]

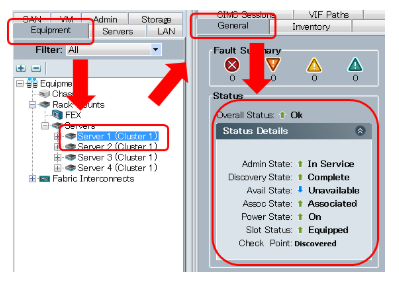

- ステイタス確認 (FE 作業)

- 対象サーバ (Equipment > Rack-Mounts > Servers > Server X) を選択して、右画面のOverall status, Operability 等のステータスを確認します。

Avail State が Unavailable となっていても問題ありません。

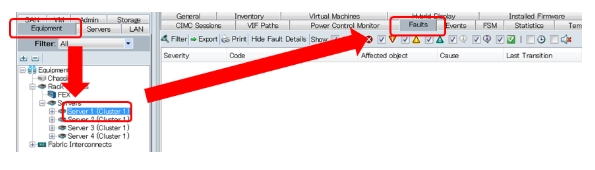

- 対象サーバ (Equipment > Rack-Mounts > Servers > Server X) を選択して、右画面の Faults タブの内容を確認しておきます。

[作業手順]

- 交換作業前準備(お客様作業 )

- 作業対象特定のために、Locator LED を点灯(Server X > General > Turn on Locator LED)してください。

- HW交換作業

1. SSDにアクセスするため、ベゼルを外します。

(キーでロックを解除し、ラッチボタンを上にスライドしながら、左端から手前に取り外します)

2.Locator LEDが点灯しているサーバーで交換対象の120GB SSD を特定します。

3.該当のSSDを抜き、新しい120GBのSSDを入れます。

- SW作業

1.該当のSSDがあるホストの Controller VMへSSHログインします。

*交換対象ノードのController VM の root パスワードを入力してください

*SSHでアクセスできない場合は、VMwareのvSphere ClientもしくはWeb clientのコンソールから実行してください。

2.以下のコマンドを該当の Controller VMで実行します。

# /usr/share/springpath/storfs-appliance/config-bootdev.sh -r -y

コマンド実行例:

root@hx-cluster-ctrlvm-n01:~# /usr/share/springpath/storfs-appliance/config-bootdev.sh -r -y

Broadcast message from root@hx-cluster-ctrlvm-n01.jpsvhx.com (console) (Tue Nov

[/usr/share/springpath/storfs-appliance/monitor-bootdev.sh]: stctlvm boot disk discovered. Rebooting in 60 seconds

Broadcast message from root@hx-cluster-ctrlvm-n01.jpsvhx.com

(/dev/console) at 22:48 ...

The system is going down for reboot NOW!

3. 該当のController VMが自動で再起動するので、10分程度待って、SSHログインし、以下のコマンドでパーティション(sdb)が作成されていることを確認します。

# df -ah

コマンド実行結果例:

root@hx-cluster-ctrlvm-n01:~# df -ah

<省略>

/dev/sda1 2.4G 1.6G 706M 70% /var/.old-root-ssh

/dev/sda1 2.4G 1.6G 706M 70% /etc/springpath/.old-secure

/dev/sdb1 63G 77M 60G 1% /var/stv

/dev/sdb2 24G 45M 23G 1% /var/zookeeper

/dev/sdb1 63G 77M 60G 1% /var/core

/dev/sdb1 63G 77M 60G 1% /var/log

/dev/sdb1 63G 77M 60G 1% /tmp

/dev/sdb1 63G 77M 60G 1% /opt/graphite

<省略>

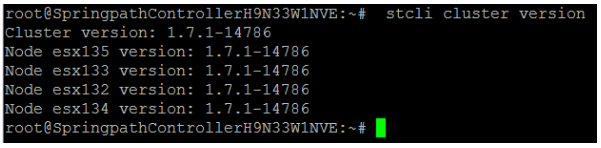

4.以下のコマンドを別のController VMで実行し、Cluster version がすべてのノードで同一であることを確認します。

*交換対象ノード以外のController VM(任意の1台)の root パスワードを入力してください

# stcli cluster version

コマンド実行結果例:

5.HX Data Platform installer VM から Installer package をコピーします。

# scp root@<installer VM _IP>:/opt/springpath/packages/storfs-packages-<バージョン>.tgz /tmp

*パスワードを聞かれた場合、 HX Data Platform installer VM の root パスワードを入力してください

# cd /tmp

# tar zxvf storfs-packages-<バージョン>.tgz

6.(HX 4.0の場合) 別のController VMの springpath_keystore.jceks と springpath_security.properties(/etc/springpath/secure/ 配下)を、交換対象のController VMの同じ場所にコピーします。

# scp root@<別のController VMのIP>:/etc/springpath/secure/springpath_* /etc/springpath/secure/

コマンド実行結果例:

# scp root@1.X.X.X:/etc/springpath/secure/springpath_* /etc/springpath/secure/

Operating in CiscoSSL FIPS mode

FIPS mode initialized

HyperFlex StorageController 4.0(2b)

root@1.X.X.X's password:

springpath_keystore.jceks 100% 2700 2.6KB/s 00:00

springpath_security.properties 100% 292 0.3KB/s 00:00

7.HX Data Platform installer deployment script を実行し、Promptが戻ってくるまで待ちます。

# ./inst-packages.sh

コマンド実行結果例:

root@hx-cluster-ctrlvm-n01:/tmp# ./inst-packages.sh

./inst-packages.sh: line 122: /bin/springpath: No such file or directory

Installing HyperFlex Software Packages

<省略>

Found initrd image: /boot/initrd.img-4.4.0-133-generic

done

HyperFlex software packages successfully installed.

Success=157 Failed=0

#### HX 4.0では、Success等は出力されなくなりました。

# ./inst-packages.sh

/sbin/ldconfig.real: /usr/lib/x86_64-linux-gnu/libgd.so.2 is not a symbolic link

Generating grub configuration file ...

Found linux image: /boot/vmlinuz-4.15.0-64-generic

Found initrd image: /boot/initrd.img-4.15.0-64-generic

Found unknown Linux distribution on /dev/sdb1

done

find: '/var/stv/.packages/': No such file or directory

find: '/var/stv/.packages/': No such file or directory

Generating grub configuration file ...

Found linux image: /boot/vmlinuz-4.15.0-64-generic

Found initrd image: /boot/initrd.img-4.15.0-64-generic

Found unknown Linux distribution on /dev/sdb1

done

8.インストールが終わったら以下のコマンドを実行しサービスが実行されていることを確認します。

# status storfs

実行結果例:

storfs running

9.Controller VMを再起動させます。

# reboot

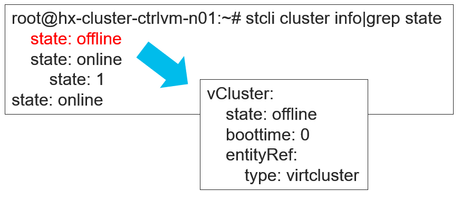

10.作業対象のController VMで、ステータスを確認します。

# stcli cluster info | grep state

11.vClusterがofflineになっている場合は、別のController VMでstcli node add -fコマンドを実行します。

root@hx-cluster-ctrlvm-n03:~# stcli node add --node-ips <作業対象のESXiのIPアドレス> --esx-username root -f

Enter Adding Controller's Root Password:

Enter ESX Hosts Root Password:

<省略>

Successfully added nodes

state: online

upgradeState: ok

<省略>

【作業後ステイタス確認】

1.以下のコマンドをいずれかのController VMで実行し、以下のコマンドで healthState が healthy、 activeNodes が元のノード数になっている事を確認します。

# stcli cluster info|grep -e healthState -e activeNodes

healthState: healthy

activeNodes: 3